C# - 로지스틱 회귀를 이용한 선형분리 불가능 문제의 분류

지난번의 글에서 다룬 소스 코드가,

C# - 로지스틱 회귀를 이용한 분류

; https://www.sysnet.pe.kr/2/0/11955

"θ

T * x"의 계산식이 단순한 1차 식을 사용했으므로,

θT * x = θ0 * x0 + θ1 * x1 + θ2 * x2

= θ0 + θ1 * x1 + θ2 * x2 = 0

선형적인 데이터 분류에만 사용할 수 있었습니다. 하지만, 최소 자승법에 했던 방식과 유사하게,

C# - 다항식을 위한 최소 자승법(Least Squares Method)

; https://www.sysnet.pe.kr/2/0/11921

2차 함수로 확장시켜주면,

θT * x = θ0 * x0 + θ1 * x1 + θ2 * x2 + θ3 * x1 * x1

= θ0 + θ1 * x1 + θ2 * x2 + θ3 * x1 * x1 = 0

간단하게 선형 분리 불가능 문제도 해결할 수 있습니다.

코드 변경은 딱 2군데만 해주면 됩니다. 우선 θ 값을 하나 더 늘려주고,

// 매개변수 초기화

Vector<double> theta = Vector<double>.Build.Dense(SystemRandomSource.Default.NextDoubles(4));

데이터의 벡터도 역시 늘려주면 끝입니다.

// ImageRect.cs

public Vector<double> AsVectorX()

{

return Vector<double>.Build.Dense(new double[] { 1.0, X1, X2, X1 * X1 });

}

이렇게 하고

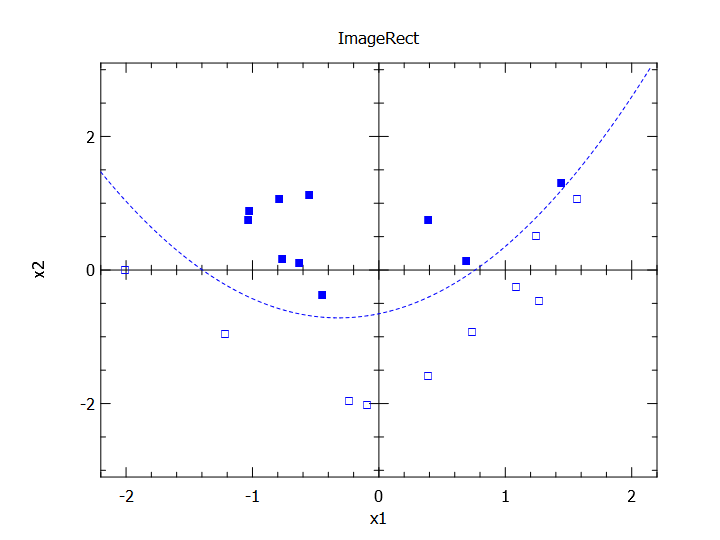

책에서 나온 data3.csv에 대해 분류를 하면 다음과 같이 출력되는 것을 확인할 수 있습니다.

(확장 함수의 도움을 받아 작성한 ^^) 핵심 소스 코드를,

static void Main(string[] args)

{

MLContext ctx = new MLContext();

string inputFileName = "data3.csv";

IDataView data = ctx.Data.LoadFromTextFile<ImageRect>(inputFileName, separatorChar: ',', hasHeader: true);

// 매개변수 초기화

Vector<double> theta = Vector<double>.Build.Dense(SystemRandomSource.Default.NextDoubles(4));

var dataList = ctx.Data.CreateEnumerable<ImageRect>(data, false);

var statInfo = dataList.GetStatisticsInfo();

// 표준화

var imgList = dataList.NormalizeZscore(statInfo);

Matrix<double> X = imgList.ToMatrix();

Vector<double> train_y = imgList.ToVectorY();

Console.WriteLine(X);

// 시그모이드 함수

Func<Matrix<double>, Vector<double>, Vector<double>> f = (x, t) =>

1 / (1 + exp(-x * theta));

// 학습률

double ETA = 1e-3;

// 반복 횟수

int epoch = 5000;

// 갱신 횟수

for (int i = 0; i < epoch * 1; i ++)

{

theta = theta - ETA * (f(X, theta) - train_y) * X;

// Console.WriteLine(theta);

}

Console.WriteLine($"theta = {theta}");

OutputChart(imgList, theta);

}

파이썬과 비교해보는 것도 좋겠지요. ^^

wikibook/math-for-ml

; https://github.com/wikibook/math-for-ml/blob/master/classification2_logistic_regression.py

(

첨부 파일은 이 글의 소스 코드를 포함합니다.)

[이 글에 대해서 여러분들과 의견을 공유하고 싶습니다. 틀리거나 미흡한 부분 또는 의문 사항이 있으시면 언제든 댓글 남겨주십시오.]